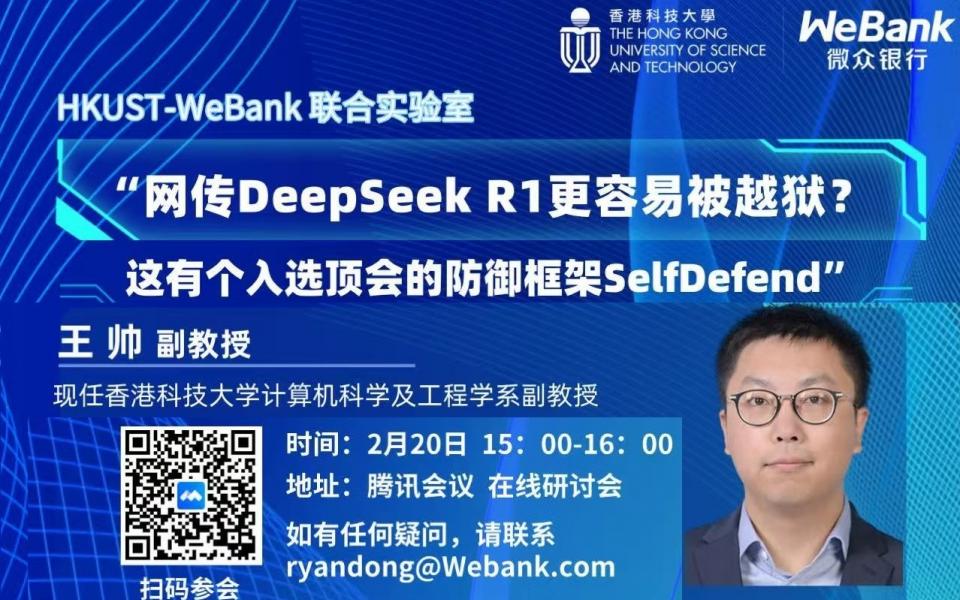

HKUST-WeBank Joint Laboratory Seminar on DeepSeek - 网传DeepSeek R1更容易被越狱?这有个入选顶会的防御框架SelfDefend

Supporting the below United Nations Sustainable Development Goals:支持以下聯合國可持續發展目標:支持以下联合国可持续发展目标:

HKUST-WeBank 联合实验室 分享 "网传DeepSeek R1更容易被越狱?这有个入选顶会的防御框架SelfDefend"

一、 引言:AI大模型的安全与风险 (2-3分钟)

简要介绍AI大模型的快速发展及其在各个领域的广泛应用。

引出AI大模型存在的安全隐患,强调其潜在风险和对社会的影响。

二、 AI大模型的安全隐患 (5-7分钟)

2.1 越狱 (Jailbreaking):

解释越狱的概念,即利用漏洞绕过AI模型的安全限制。

举例说明越狱的危害,例如生成虚假信息、进行网络攻击等。

2.2 注入攻击 (Prompt Injection):

解释注入攻击的概念,即通过精心设计的输入操纵AI模型的输出。

举例说明注入攻击的危害,例如窃取敏感信息、传播恶意软件等。

2.3 幻觉 (Hallucination):

解释幻觉的概念,即AI模型生成虚假或误导性的信息。

举例说明幻觉的危害,例如误导决策、损害公信力等。

2.4 策略性欺骗

2.5 其他安全隐患:

简要提及其他安全隐患,例如数据泄露、算法偏见等。

三、 引入论文:针对越狱攻击的防御方案 (1-2分钟)

简要介绍论文的研究背景和动机,即针对上述某种或多种安全隐患,提出了一种新的解决方案。

强调论文的创新性和重要性,例如提出了新的算法、框架或评估方法等。

四、 论文主要内容介绍 (10-12分钟)

4.1 研究问题:

清晰地定义论文要解决的具体问题。

4.2 研究方法:

详细介绍论文提出的解决方案,包括算法、模型、框架等。

使用图表、示例等方式辅助解释,使内容更易于理解。

4.3 实验结果:

展示论文的实验结果,并与现有方法进行对比,突出论文方法的优势。

使用图表、数据等方式直观地展示实验结果。

4.4 结论与展望:

总结论文的主要贡献和创新点。

展望未来的研究方向和应用前景。

五、 总结与互动 (2-3分钟)

简要总结论文的主要内容和贡献。

请于海报扫码参于会在线研讨会。

如有任何疑问,请联系 Mr. Ryan Dong (ryandong@Webank.com), Mr. Joshua Leung (joshua.leung@ust.hk)